Gino News

quarta-feira, 29 de janeiro de 2025

Aprenda a Aperfeiçoar o Modelo Multimodal Llama-3.2 com Aceleradores da Intel

Neste artigo, o autor apresenta um tutorial sobre como realizar o fine-tuning do modelo multimodal Llama-3.2 11B Vision Instruct da Meta, utilizando aceleradores Intel, focando na implementação em um ambiente Docker e utilizando Low-Rank Adaptation para eficiência no treinamento.

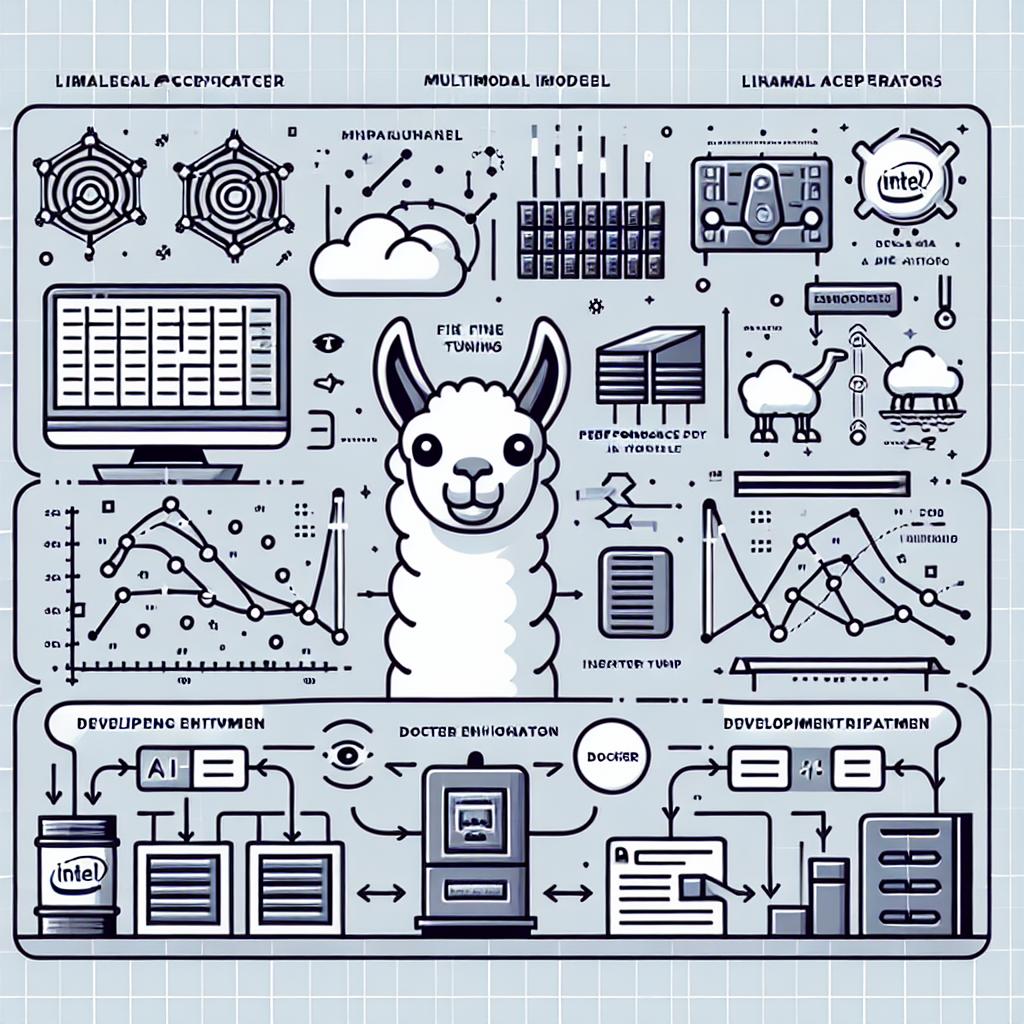

Imagem gerada utilizando Dall-E 3

Os Multimodal Large Language Models (MLLMs) são extensões dos Large Language Models (LLMs) que incorporam diferentes mídias, como imagens, áudio e vídeo, além de texto. O artigo se concentra em uma subcategoria chamada Visual Language Models (VLMs), que geram saídas de texto a partir de entradas de imagem e texto. O modelo Llama-3.2 11B Vision Instruct foi desenvolvido para responder perguntas sobre imagens, o que o torna uma escolha ideal para demonstrar o fine-tuning apresentado.

Para utilizar os modelos da Meta Llama, é necessário solicitar acesso no Hugging Face e configurar o ambiente Docker com as dependências necessárias. O autor fornece um Dockerfile detalhado para facilitar a replicação do ambiente, e destaca a importância de configurar corretamente os aceleradores Intel Gaudi 2 para otimizar o treinamento.

Definição de MLLMs e VLMs.

Processo de solicitação de acesso aos modelos Llama no Hugging Face.

Configuração do ambiente Docker.

Utilização do dataset de pares imagem-caption para o fine-tuning.

Implementação da técnica Low-Rank Adaptation (LoRA) para eficiência no treinamento.

Resultados do fine-tuning e comparação entre o modelo original e o fine-tunado.

Após o fine-tuning, o autor descreve a execução de testes com o modelo ajustado, usando um conjunto de dados de teste. A análise dos resultados demonstra que o modelo fine-tunado apresenta respostas mais diretas, conforme os dados de treinamento, embora ambos os modelos tenham se saído bem. Esse processo destaca a capacidade de adaptação dos modelos multimodais para tarefas específicas.

Este artigo fornece uma visão abrangente sobre o fine-tuning de modelos multimodais como o Llama-3.2, utilizando ferramentas como Docker e aceleração com Intel. O leitor é incentivado a explorar a configuração e testes de modelos semelhantes, além de acompanhar novidades e tutoriais que serão disponibilizados regularmente em nossa newsletter. Mantenha-se atualizado com conteúdos relevantes sobre inteligência artificial e técnicas de machine learning.

FONTES:

REDATOR

Gino AI

29 de janeiro de 2025 às 23:50:09

PUBLICAÇÕES RELACIONADAS