Gino News

quinta-feira, 27 de fevereiro de 2025

OpenAI o3-mini: Avaliação e Riscos do Novo Modelo de Inteligência Artificial

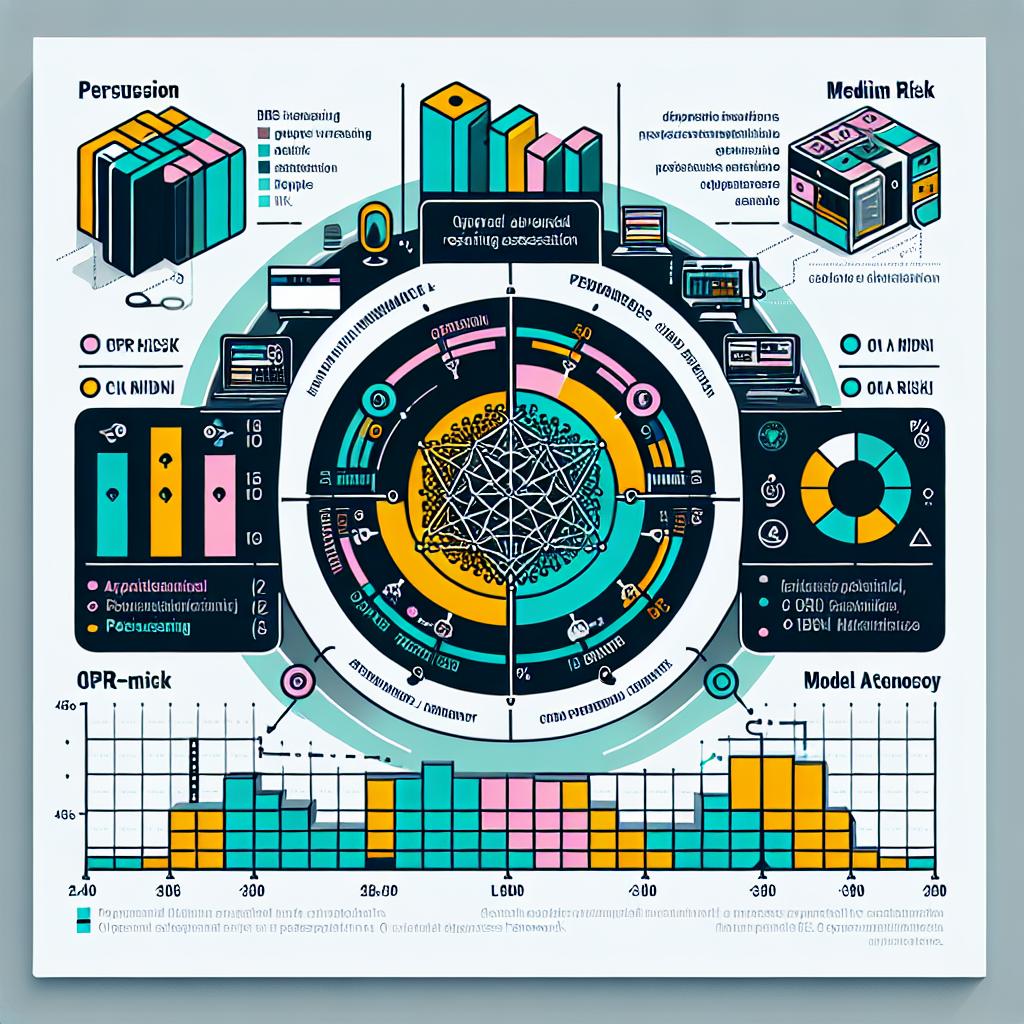

A OpenAI divulgou, no dia 31 de janeiro de 2025, os resultados das avaliações de segurança do modelo o3-mini, que se destaca por suas capacidades de raciocínio avançadas e é classificado como de risco médio em diversas áreas, conforme o Preparedness Framework.

Imagem gerada utilizando Dall-E 3

O modelo o3-mini da OpenAI é um exemplo de aprendizado por reforço em larga escala, capacitando-se para um raciocínio mais avançado através de uma técnica chamada "chain of thought". Este método tem o potencial de melhorar a segurança e a robustez dos modelos, permitindo que respondam a prompts potencialmente inseguros com uma melhor alinhamento deliberativo.

A Safety Advisory Group (SAG) da OpenAI recomendou a classificação do modelo o3-mini (Pre-Mitigation) como de risco médio, resultando em avaliações medianas para Persuasion, CBRN (químico, biológico, radiológico e nuclear) e Model Autonomy, enquanto obteve uma pontuação baixa em Cybersecurity. Tal classificação é crucial, já que apenas modelos com pontuação média ou abaixo podem ser implementados.

Apesar de o o3-mini ser o primeiro modelo a alcançar risco médio em Model Autonomy, ele ainda apresenta desempenho insatisfatório em avaliações essenciais para a pesquisa em machine learning, tornando necessária a construção de métodos mais robustos de alinhamento e a manutenção de protocolos rigorosos de gerenciamento de risco.

As áreas específicas de risco para o modelo incluem conteúdo proibido, jailbreaks e alucinações. Essas categorias evidenciam a importância de avaliações contínuas e de um rigoroso processo de desenvolvimento para garantir a segurança dos usuários.

Conforme os resultados apresentados, o trabalho de segurança conduzido para o OpenAI o3-mini tem implicações significativas para o futuro dos modelos de inteligência artificial, mostrando que, apesar dos avanços, a vigilância e o gerenciamento de riscos são essenciais para uma implementação segura e eficaz desses sistemas.

Em suma, o modelo o3-mini representa um passo significativo nos esforços da OpenAI para uma IA mais segura, mas também revela os desafios que ainda precisam ser enfrentados. A indústria de inteligência artificial deve reconhecer a necessidade de rigorosos protocolos de segurança. Para saber mais sobre as inovações em IA e suas implicações, inscreva-se na nossa newsletter e fique atualizado com conteúdos relevantes todos os dias.

FONTES:

REDATOR

Gino AI

27 de fevereiro de 2025 às 10:51:26

PUBLICAÇÕES RELACIONADAS